Στην εποχή της ψηφιακής πληροφορίας, όπου τα δεδομένα αποτελούν πολύτιμο πόρο για κάθε τομέα της επιστήμης και της τεχνολογίας, η προστασία της ιδιωτικότητας έχει αποκτήσει πρωταρχική σημασία. Η τεχνητή νοημοσύνη (AI) και το deep learning έχουν αναδείξει νέες δυνατότητες στην ανάλυση και αξιοποίηση τεράστιων ποσοτήτων δεδομένων, αλλά ταυτόχρονα προκύπτει το δίλημμα της διατήρησης της εμπιστευτικότητας των προσωπικών πληροφοριών. Σε αυτό το πλαίσιο γεννήθηκε η έννοια του Differential AI, η οποία συνδυάζει τις εξελιγμένες τεχνικές της AI με το αυστηρό μαθηματικό πλαίσιο της Differential Privacy για να δημιουργήσει συστήματα που είναι ικανά να επεξεργάζονται δεδομένα χωρίς να διακυβεύουν την ιδιωτικότητα των χρηστών.

Η Differential Privacy αποτελεί ένα μαθηματικά αυστηρό πλαίσιο σχεδιασμένο για να εξασφαλίζει ότι η ανάλυση δεδομένων δεν αποκαλύπτει πληροφορίες για κανένα συγκεκριμένο άτομο. Ο βασικός στόχος είναι να διασφαλιστεί ότι η έξοδος οποιουδήποτε υπολογισμού ή μοντέλου δεν θα επιτρέπει σε κάποιον να συμπεράνει ανησυχητικά δεδομένα για ένα άτομο, ακόμα και αν ο επιτιθέμενος έχει πρόσβαση σε σχεδόν όλα τα δεδομένα. Η κεντρική ιδέα υλοποιείται με τον ακόλουθο τρόπο: για δύο δεδομένα (datasets) που διαφέρουν μόνο κατά μία εγγραφή, η πιθανότητα να παραχθεί ένα συγκεκριμένο αποτέλεσμα από ένα μηχανισμό ανάλυσης δεν πρέπει να διαφέρει πολύ, κάτι που μετριέται με τη χρήση του παράγοντα ε (epsilon). Μικρότερες τιμές του ε υποδηλώνουν αυστηρότερη προστασία, καθώς ο επιτρεπτός “θόρυβος” που προστίθεται στην ανάλυση είναι μεγαλύτερος, εμποδίζοντας έτσι την αποκάλυψη ατομικών πληροφοριών.

Πώς Ενσωματώνεται η Differential Privacy στην AI

Η εφαρμογή της Differential Privacy στην AI οδηγεί στη δημιουργία του λεγόμενου Differential AI. Σε αυτό το μοντέλο, οι αλγόριθμοι μηχανικής μάθησης εκπαιδεύονται με τέτοιο τρόπο ώστε να επεξεργάζονται δεδομένα που περιέχουν ευαίσθητες πληροφορίες, χωρίς όμως να επιτρέπουν την ανάκτηση συγκεκριμένων ατομικών στοιχείων από τα τελικά αποτελέσματα. Αυτό επιτυγχάνεται με την προσθήκη ελεγχόμενου θορύβου στα δεδομένα ή στα ενδιάμεσα αποτελέσματα κατά τη διάρκεια της διαδικασίας μάθησης. Η προσέγγιση αυτή είναι ιδιαίτερα κρίσιμη όταν εργάζονται σε τομείς όπως η υγειονομική περίθαλψη ή οι χρηματοοικονομικές υπηρεσίες, όπου η αποκάλυψη ατομικών πληροφοριών μπορεί να έχει σοβαρές επιπτώσεις.

Ένα χαρακτηριστικό παράδειγμα είναι η εφαρμογή του Differentially Private Stochastic Gradient Descent (DP-SGD) στα deep learning μοντέλα. Κατά τη διάρκεια της εκπαίδευσης ενός νευρωνικού δικτύου, αντί να ενημερώνονται οι παράμετροι του μοντέλου απευθείας με βάση τα ακριβή gradients που προκύπτουν από κάθε δεδομένο δείγμα, οι gradients πρώτα “κλιμακώνονται” ώστε να περιορίζεται η συμβολή κάθε ατομικού δείγματος. Στη συνέχεια, προστίθεται θόρυβος, συνήθως από μια Gaussian κατανομή, προτού τα δεδομένα αυτά χρησιμοποιηθούν για την ενημέρωση των παραμέτρων. Με αυτόν τον τρόπο, ακόμα και αν κάποιος επιχειρήσει να αναστρέψει τη διαδικασία και να εξαγάγει πληροφορίες για συγκεκριμένα δείγματα, ο πρόσθετος θόρυβος καθιστά αυτή τη διαδικασία σχεδόν αδύνατη.

Μαθηματική Διάσταση και Επιπτώσεις

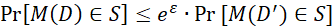

Η μαθηματική διατύπωση της Differential Privacy προσφέρει ένα σαφές πλαίσιο μέτρησης της ιδιωτικότητας. Σύμφωνα με τη βασική της εξίσωση, για οποιαδήποτε δύο datasets D και D′ που διαφέρουν κατά μία εγγραφή και για κάθε πιθανό σύνολο εξόδου S, ο μηχανισμός M που εφαρμόζεται ικανοποιεί την ανισότητα:

Η έννοια αυτή εξασφαλίζει ότι η διαφορά στα αποτελέσματα μεταξύ των δύο datasets παραμένει περιορισμένη, ανεξάρτητα από το πόσο πολύ μπορεί να επηρεάσει μία μόνο εγγραφή την έξοδο του συστήματος. Η μαθηματική αυστηρότητα που προσφέρει αυτή η προσέγγιση δημιουργεί ένα επίπεδο εμπιστοσύνης, τόσο για τους χρήστες όσο και για τους οργανισμούς που αναπτύσσουν και χρησιμοποιούν τα μοντέλα AI.

Παραδείγματα Εφαρμογής και Πρακτική Εμπειρία

Σκεφτείτε μια μεγάλη εταιρεία τεχνολογίας που διαχειρίζεται τεράστιες βάσεις δεδομένων από τους χρήστες της, με σκοπό τη βελτιστοποίηση της εμπειρίας χρήστη μέσω συστημάτων σύστασης (recommendation systems). Σε μια τέτοια περίπτωση, οι αλγόριθμοι που εφαρμόζονται μπορούν να επωφεληθούν από το Differential Privacy για να εξασφαλίσουν ότι, ενώ το σύστημα μαθαίνει από τις προτιμήσεις και τις συμπεριφορές των χρηστών, δεν αποκαλύπτει ακριβείς προσωπικές πληροφορίες που θα μπορούσαν να ταυτοποιήσουν κάποιον χρήστη. Με την εφαρμογή τεχνικών όπως το DP-SGD, κάθε ενημέρωση των παραμέτρων του μοντέλου γίνεται με τέτοιο τρόπο ώστε η συμβολή κάθε ατομικού δείγματος να γίνεται αόρατη στο τελικό αποτέλεσμα.

Ένα άλλο παράδειγμα αποτελεί ο τομέας της ιατρικής έρευνας. Σε περιπτώσεις όπου οι ερευνητές επιδιώκουν να αναπτύξουν μοντέλα πρόγνωσης ασθενειών χρησιμοποιώντας ευαίσθητα ιατρικά δεδομένα, η χρήση Differential Privacy επιτρέπει την ανάλυση αυτών των δεδομένων χωρίς να παραβιάζεται η εμπιστευτικότητα των ασθενών. Ο θόρυβος που προστίθεται κατά την επεξεργασία των δεδομένων διασφαλίζει ότι τα αποτελέσματα που παράγει το μοντέλο αντανακλούν τα γενικά χαρακτηριστικά του πληθυσμού, χωρίς να αποκαλύπτονται προσωπικές πληροφορίες που θα μπορούσαν να χρησιμοποιηθούν για αναγνώριση.

Η Σημασία της Προστασίας της Ιδιωτικότητας στον Ψηφιακό Κόσμο

Η ενσωμάτωση της Differential Privacy στα συστήματα AI δεν αποτελεί απλά μια τεχνική βελτιστοποίησης, αλλά μια αναγκαιότητα σε έναν κόσμο όπου τα προσωπικά δεδομένα συλλέγονται και αναλύονται σε ακραίες ποσότητες. Με την εφαρμογή του Differential AI, οι οργανισμοί μπορούν να εκμεταλλευτούν τις δυνατότητες της τεχνητής νοημοσύνης, ενώ ταυτόχρονα τηρούν τις ηθικές και νομικές υποχρεώσεις που αφορούν την προστασία της ιδιωτικότητας. Η χρήση αυτής της τεχνικής βοηθά στη δημιουργία ενός περιβάλλοντος εμπιστοσύνης, όπου οι χρήστες νιώθουν ασφαλείς καθώς τα δεδομένα τους επεξεργάζονται με υπεύθυνο τρόπο.

Επιπλέον, η προσέγγιση αυτή προάγει τη διαφάνεια και την αξιοπιστία των συστημάτων AI. Οι οργανισμοί που υιοθετούν Differential Privacy μπορούν να επιδείξουν στους χρήστες τους ότι λαμβάνουν σοβαρά υπόψη την προστασία των προσωπικών δεδομένων, κάτι που συμβάλλει στην οικοδόμηση μακροχρόνιων σχέσεων εμπιστοσύνης. Επιπρόσθετα, η αυστηρή μαθηματική βάση που στηρίζει το Differential Privacy διευκολύνει την ανάπτυξη νέων μεθοδολογιών και την έρευνα στον τομέα της ιδιωτικότητας, ανοίγοντας το δρόμο για καινοτόμες εφαρμογές που συνδυάζουν την ακρίβεια των μοντέλων AI με την απαράμιλλη προστασία των δεδομένων.

Καθώς ο κόσμος κινείται προς μια ολοένα και πιο ψηφιοποιημένη πραγματικότητα, οι ανησυχίες για την ιδιωτικότητα γίνονται όλο και πιο έντονες. Η ενσωμάτωση της Differential Privacy στα συστήματα τεχνητής νοημοσύνης, αποτελεί μία από τις πιο ουσιώδεις προσεγγίσεις για την αντιμετώπιση αυτών των ανησυχιών. Μέσω της προσεκτικής διαχείρισης του “privacy budget” και της ελεγχόμενης προσθήκης θορύβου, οι αλγόριθμοι μπορούν να επωφεληθούν από τις τεράστιες δυνατότητες των δεδομένων, χωρίς να διακυβεύουν την ασφάλεια και την εμπιστευτικότητα των ατομικών πληροφοριών.

Το Differential AI αναδεικνύει τη δυνατότητα δημιουργίας τεχνολογιών που δεν εξυπηρετούν μόνο σκοπούς απόδοσης και αποτελεσματικότητας, αλλά και την προστασία θεμελιωδών ανθρωπίνων δικαιωμάτων. Με αυτόν τον τρόπο, δεν επιτυγχάνεται μόνο μια τεχνική βελτιστοποίηση των συστημάτων, αλλά δημιουργείται ένα περιβάλλον όπου η καινοτομία και η ηθική συνυπάρχουν αρμονικά. Αυτό το μοντέλο αποτελεί έναν οδηγό για τους ερευνητές και τους επαγγελματίες του χώρου, καθώς συνεχίζουν να αναπτύσσουν εφαρμογές που θα πρέπει να σέβονται τόσο την επιστημονική ακρίβεια όσο και την κοινωνική ευθύνη.

Σε μια εποχή που χαρακτηρίζεται από ραγδαίες τεχνολογικές εξελίξεις, η διασφάλιση της ιδιωτικότητας δεν είναι πλέον προαιρετική. Αντιθέτως, αποτελεί έναν ακρογωνιαίο λίθο για την υιοθέτηση υπεύθυνων πρακτικών στην επεξεργασία δεδομένων. Με την ενσωμάτωση των αρχών του Differential Privacy στα συστήματα AI, μπορούμε να προχωρήσουμε με βήματα σίγουρα προς ένα μέλλον όπου η τεχνολογία ενισχύει την ποιότητα ζωής, χωρίς να διακυβεύει την προσωπική ελευθερία και την εμπιστευτικότητα των ατόμων.

Έτσι, το Differential AI αναδεικνύεται ως ένας κρίσιμος συνδυασμός καινοτομίας και προστασίας, εξασφαλίζοντας ότι όσο προχωράμε στην αξιοποίηση των τεράστιων δυνατοτήτων της τεχνητής νοημοσύνης, παράλληλα προστατεύουμε και διαφυλάττουμε την ιδιωτικότητα κάθε χρήστη. Η υιοθέτηση τέτοιων τεχνικών όχι μόνο ενισχύει την τεχνολογική υπεροχή των οργανισμών, αλλά και θέτει τα θεμέλια για μια πιο δίκαιη, διαφανή και ασφαλή ψηφιακή κοινωνία.